行业洞察|德勤可信AI监管框架助力银行业风险治理

发布时间:2025-02-10 01:46分类: 无 浏览:487评论:0

德勤中国金融服务业研究中心近日发布《慎终如始 稳进相济 进而有为:中国银行业2023年发展回顾及2024年展望》报告,内容涵盖了2023年经济及金融形势回顾、2023年上市银行业绩分析、2023年上市银行业务观察、行业热点话题探讨及2024年宏观经济和银行业发展展望五个章节,逾190页。

报告精华章节将以连载形式刊发,此文为连载第十六篇。

近年来,人工智能(AI)的应用范围和深度都在飞速扩展,从最初的自动化处理和数据分析,逐步深入到更复杂的决策支持和问题解决模式,推动着新型服务、产品创新以及各行各业的数字化转型。

AI技术的发展也带来了一系列的挑战和问题,世界各地的监管机构也开始围绕这项不断发展的技术制定立法和监管框架。特别是在银行业,AI的应用深化或扩大了现有模型的风险场景,对模型风险管理提出了新的挑战,如何用好这把双刃剑,成为商业银行风险管理需要思考和应对的问题。

国际国内监管沿革

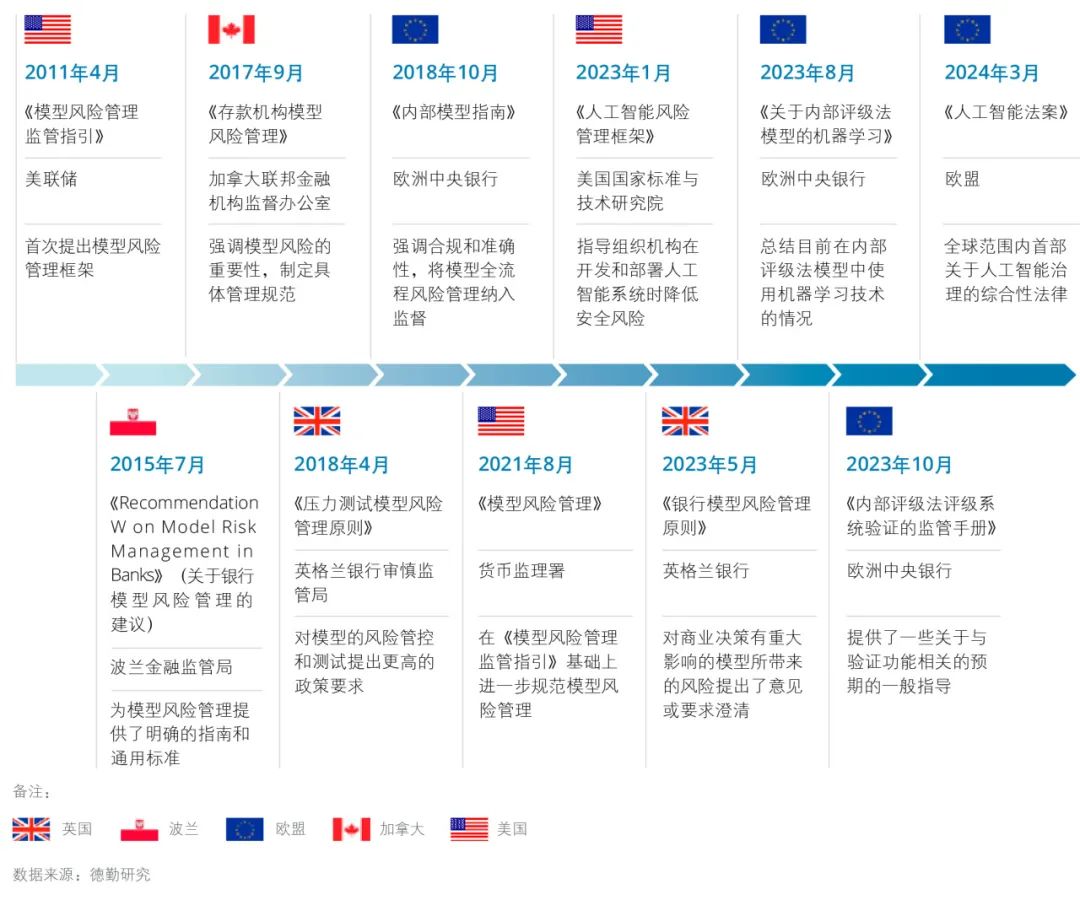

2011年以来国外监管机构针对模型风险发布的监管法规

国内在商业银行模型风险管理的监管方面紧跟国际步伐。2020年以来国内监管机构发布的模型风险相关法规如下:

风险和挑战

国内外监管机构对模型风险的关注度不断提高,并提升到上位法的层次,与AI的飞速发展及其带来的新型风险息息相关。相较于商业银行的传统模型风险管理,AI的应用带来或扩大了以下几种风险:

1.

模型偏见和歧视:AI模型中可能出现两种偏见:一种是以算法或数据偏差为中心的偏差,当用于训练算法的数据集本身存在偏差时,可能会出现这种偏差;第二种是社会AI偏差,即AI反映了社会不容忍或制度性歧视。因此,当AI系统根据与任务或决策无关的因素区别对待或不公平地对待某些人或群体时,往往会给这些人或群体带来负面结果。

2.

模型透明度和可解释性:大模型,尤其是深度学习模型,往往是“黑箱”模型,其决策过程难以解释。这对需要高度透明和可解释性的金融领域带来了挑战。模型任何类型的自动决策方法必须透明和可解释,还需要具备人工审核和推翻的能力,并将学习结果反馈到模型。如果模型设计人员和使用人员对其不清楚或不理解,这一挑战就会变得更加复杂。

3.

错误信息或虚假信息:生成式AI可能生成错误信息,也就是所谓的“模型幻觉”,这增大了内容审核环节的负担,而过度依赖不准确的内容可能造成决策失误和其他损失。

4.

推理攻击:攻击者在与生成式AI交互时,通过提示词尝试推断或推理出攻击者无法访问的数据的更多信息,如攻击者可能会试图找出用于训练AI系统的信息类型、存储方式、内部逻辑等,这些信息可能因推理攻击而破坏或泄露。

5.

知识产权:大部分AI模型都进行了开源,但这些开源许可协议的各自应用范围不同。因此,在进行模型商业化应用时需重点关注合规性,避免侵犯知识产权。

6.

数据隐私和安全:大模型通常需要处理和分析巨量的个人和敏感数据。如果数据保护措施不当,可能导致数据泄露,增加个人隐私侵犯的风险。

7.

模型稳定性:大模型可能因为各种原因(如数据漂移、过拟合等)而表现不稳定。在商业银行,大模型的这种不稳定性可能导致错误的预测和决策。

8.

技术管理和复杂度:大模型通常需要高度专业化的技术和管理,商业银行可能缺乏运行和维护这些模型所需的专业知识或专业人员,从而增加了操作风险发生的可能性。

解决思路

应用德勤TrustAI框架(可信AI框架)进行AI模型的治理,将其嵌入商业银行的模型风险管理流程,能协助机构在模型应用中维护客户隐私、保障安全并遵守相关法律法规。

1. 公平/公正

AI系统应与其他模型一样,按照一致的流程确定应用规则,并将其纳入内部和外部检查范围,以消除可能导致歧视或不同结果的偏见,从而确保公平和公正。

2. 透明/可解释

AI系统可能不会像“黑箱”一样运行,所有与AI交互的各方知晓对方是AI而不是人类,并能够了解系统的决策依据和原因。

3. 负责任/可追责

AI系统的复杂性和自主性日益增强,可能会模糊这些系统决策和行动背后的决策者的最终责任和问责。应制定政策并明确责任归属,帮助受AI决策影响的相关方在遭受损失时能够有相应的追索权。

4. 稳健性和可靠性

随着AI技术被广泛应用于各类系统,机构对AI系统的稳健性和可靠性要求应该等同或高于对人类专业人员的要求。

5. 隐私保护

由于AI系统通常依赖于收集大量数据来有效完成任务,应确保所有数据都是在充分了解和同意的情况下适当收集的,满足相关法律法规对隐私保护的要求。

6. 安全可靠

随着AI系统对更多关键流程的控制权越来越大,网络攻击和其他危害的危险也大大增加。机构应采取适当的安全措施,确保驱动AI的数据和算法的完整性和安全性。

将可信AI框架嵌入模型风险管理流程,需要如下步骤:

典型的举措包括:

在模型治理和管控架构设计阶段,明确不同利益相关方在模型管理生命周期中的角色和责任,建立AI伦理咨询委员会;

在模型构建阶段,采用差分隐私等技术措施,保护用户隐私数据,通过重新采样,算法优化等手段优化模型的公平性和公正性,采用可解释性增强技术,如LIME、SHAP等,增强模型的可解释性;

在模型部署阶段,私有化部署降低恶意攻击风险和敏感数据泄露风险;

在模型监控阶段,基于数据质量、模型设计方法、市场变化和外部影响等情况设计模型性能监控指标,及时发现和应对性能不佳或失效风险。

AI技术正朝着更高程度的自动化和智能化方向发展,能够执行更加复杂的任务,并在无需人工干预的情况下做出决策;AI尤其是深度学习的能力不断增强,能够处理和分析的数据量呈指数级增长;AI与边缘计算和物联网结合,可以使智能分析更加靠近数据源,从而实现更快速的反应和更高效的资源利用。

在此过程中,商业银行无论是要为受益于AI的各行各业提供更优质的金融服务,还是自身应用AI来提高风险管理的能力,以应对激烈的市场竞争和严格的监管要求,都面临着极大的挑战。唯有变中求新、变中求进、变中突破,通过合适的治理框架和管理手段保障其是可信AI,才能有效赋能商业银行的模型风险管理,成为数字化时代的新质生产力。

点击文末“阅读原文”

下载报告全文

业务垂询,敬请联络:

曾浩

德勤中国金融服务业

银行业及资本市场主管合伙人

电话:+86 21 6141 1821

电子邮件:calzeng@deloitte.com.cn

沈小红

德勤中国金融服务业研究中心主管合伙人

德勤中国金融服务业审计及鉴证合伙人

电话:+86 21 2312 7166

电子邮件:charshen@deloitte.com.cn

方烨

德勤中国金融服务业

风险咨询主管合伙人(中国大陆)

电话:+86 21 6141 1569

电子邮件:yefang@deloitte.com.cn

吴洁

德勤中国金融服务业

风险与合规服务主管合伙人

电话:+86 21 6141 2237

电子邮件:kwu@deloitte.com.cn

曾春

德勤中国金融服务业

风险咨询合伙人

电话:+86 21 3313 8338

电子邮件:ezeng@deloitte.com.cn

中国银行业2023年发展回顾及2024年展望报告系列连载:

《慎终如始 稳进相济 进而有为:中国银行业2023年发展回顾及2024年展望》报告发布会

连载一:2023年宏观经济和金融形势回顾及2024年展望

连载二:2023年上市银行业绩分析

连载三:上市银行业务观察之普惠金融

连载四:上市银行业务观察之房地产业务

连载五:上市银行业务观察之零售业务

连载六:上市银行业务观察之金融科技

连载七:上市银行业务观察之理财业务

连载八:AI大模型时代银行业致胜之策

连载九:银行如何实现内控合规管理智能化?

连载十:银行应当怎样做好“数据资源入表”?

连载十一:银行如何用足、用好普惠金融税费大礼包?

连载十二:银行保险机构有效管控关联交易“五步法”

连载十三:探寻银行人力资本效能的数字化红利

连载十四:金融机构洗钱风险管理机制进阶之路

连载十五:德勤解析银行业不良资产市场变化

免责声明:

第三方机构如想转载德勤微信文章,请原文转载(不得修改)。如文章内容有改动,须在发布前获得德勤的审核批准。同时,请必须在文章内附以下信息及免责声明:

本通信中所含内容乃一般性信息,任何德勤有限公司、其成员所或它们的关联机构(统称为“德勤网络”)并不因此构成提供任何专业建议或服务。任何德勤网络内的机构均不对任何方因使用本通信而导致的任何损失承担责任。

点击“阅读原文”,下载报告全文。

温馨提示:由于微信界面限制,若打开以下德勤网页后无法下载报告,请按右上角“选项”并于浏览器中打开后进行下载。

- 排行